Cercetările Deloitte indică faptul că doar 23% dintre organizații se simt pe deplin pregătite să gestioneze riscurile legate de inteligența artificială, lăsând lacune semnificative în materie de supraveghere și securitate.

- Ce este guvernanța AI?

- Cadre de guvernanță în domeniul IA

- Orientări etice și responsabilitate

- Cadre de reglementare

- Transparență și explicabilitate

- Monitorizarea și îmbunătățirea continuă

- MetaDefender Managed File Transfer MFT) – Soluție de securitate și conformitate bazată pe inteligență artificială

- Întrebări frecvente privind guvernanța securității IA

Ce este guvernanța AI?

Guvernanța inteligenței artificiale este sistemul de politici, cadre și supraveghere care direcționează modul în care inteligența artificială este dezvoltată, utilizată și reglementată. Aceasta asigură funcționarea inteligenței artificiale cu transparență, responsabilitate și securitate în cadrul organizațiilor, industriilor și guvernelor.

Protejarea sistemelor AI astfel încât acestea să poată funcționa în siguranță, în mod etic și în conformitate cu reglementările a devenit o prioritate absolută. Fără o guvernanță adecvată, sistemele AI pot introduce prejudecăți, încălca cerințele de reglementare sau deveni riscuri de securitate.

De exemplu, un instrument de recrutare AI antrenat pe baza datelor istorice de angajare poate prioritiza din greșeală anumite caracteristici demografice în detrimentul altora, consolidând modelele discriminatorii. În sectoare precum sănătatea sau finanțele, implementarea AI fără respectarea legilor regionale privind protecția datelor poate duce la încălcări ale reglementărilor și la amenzi substanțiale.

În plus, modelele AI integrate în serviciile destinate publicului fără controale adecvate de prevenire a amenințărilor pot fi exploatate prin încercări de exploatare rău intenționate, expunând organizațiile la atacuri cibernetice și întreruperi operaționale.

Principiile-cheie ale guvernanței IA

O strategie bine definită de guvernanță a IA încorporează principii esențiale care ajută organizațiile să mențină controlul asupra procesului decizional determinat de IA. Conform unui studiu realizat de Ponemon Institute, 54% dintre respondenți au adoptat inteligența artificială, în timp ce 47% dintre echipele de securitate au raportat preocupări cu privire la vulnerabilitățile introduse de codul generat de inteligența artificială.

Următoarele principii fundamentale sunt esențiale pentru o guvernanță eficientă a IA și contribuie la atenuarea riscurilor operaționale și de securitate:

Protocoalele de securitate protejează modelele AI de atacurile adversarilor, de modificările neautorizate și de amenințările cibernetice emergente

Responsabilitatea garantează că sistemele de inteligență artificială fac obiectul unei supravegheri desemnate, împiedicând luarea de decizii nereglementate și consolidând controlul uman

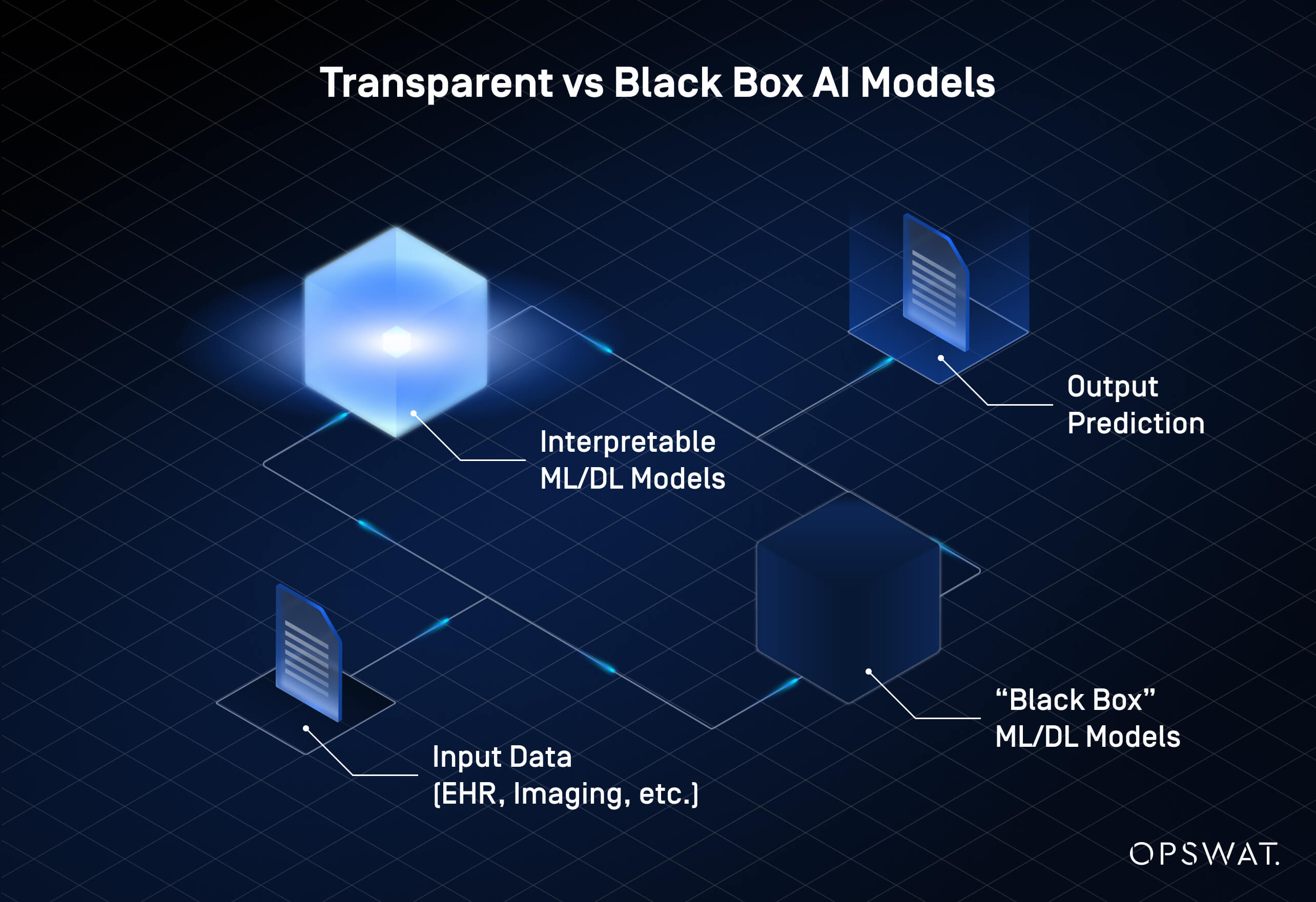

Transparența necesită ca modelele AI să ofere informații clare cu privire la procesele lor decizionale, reducând riscurile modelelor de tip cutie neagră care nu sunt interpretabile

Prin încorporarea acestor principii în cadrele de guvernanță, organizațiile pot reduce riscurile, menținând în același timp eficiența și scalabilitatea tehnologiilor AI.

Nevoia tot mai mare de gestionare a riscurilor legate de IA

Adoptarea rapidă a IA a introdus noi provocări în ceea ce privește gestionarea riscurilor și conformitatea. Fără strategii adaptive, organizațiile riscă să rămână în urmă în abordarea amenințărilor emergente și a presiunilor de reglementare.

Gestionarea riscurilor IA se concentrează pe:

- Alinierea strategiilor de guvernanță la reglementările în evoluție și la mandatele de supraveghere a IA specifice sectorului asigură îndeplinirea cerințelor legale de către organizații

- Detectarea continuă a prejudecăților și auditurile corectitudinii sunt necesare pentru a preveni modelele discriminatorii în procesul decizional al IA

- Atacurile de phishing cu ajutorul inteligenței artificiale, frauda deepfake și manipularea modelelor reprezintă preocupări tot mai mari, necesitând măsuri proactive de securitate.

Pentru a rămâne în fața acestor riscuri, organizațiile trebuie să integreze guvernanța IA în cadrele mai largi de gestionare a riscurilor, asigurându-se că aspectele legate de conformitate, securitate și etică rămân parte integrantă a dezvoltării și implementării IA.

Cadre de guvernanță în domeniul IA

Un cadru structurat de guvernanță a IA ajută organizațiile să navigheze printre cerințele de conformitate, să gestioneze riscurile și să integreze măsuri de securitate în sistemele IA. Încorporarea unui model clar de guvernanță a securității în cadrele de gestionare a riscurilor IA reduce fragmentarea inițiativelor IA și consolidează acoperirea conformității.

Dezvoltarea cadrului

Elaborarea unui cadru de guvernanță pentru IA necesită o abordare strategică care să se alinieze politicilor organizaționale și standardelor de reglementare. Următoarele elemente reprezintă componentele de bază ale unui proces eficient de elaborare a cadrului:

Evaluarea riscurilor

Identificarea vulnerabilităților modelelor AI, inclusiv a prejudecăților, a problemelor legate de confidențialitate și a amenințărilor la adresa securității.

Integrarea reglementărilor

Asigurați-vă că guvernanța IA se aliniază cerințelor specifice industriei și standardelor globale.

Colaborare interfuncțională

Creați un cadru de guvernanță care să răspundă atât preocupărilor etice, cât și nevoilor operaționale.

Integrarea cu politicile organizaționale existente

Guvernanța IA nu ar trebui să funcționeze în mod izolat, ci să se alinieze politicilor corporative mai ample privind securitatea cibernetică, etica și gestionarea riscurilor. Încorporarea politicilor privind inteligența artificială în gestionarea riscurilor întreprinderii asigură conformitatea modelelor de inteligență artificială cu protocoalele de securitate și cu orientările etice.

Mecanismele de audit AI pot ajuta la detectarea timpurie a eșecurilor de guvernanță, în timp ce urmărirea conformității permite organizațiilor să rămână în fața evoluției reglementărilor. Parteneriatele externe cu furnizorii de AI și cu furnizorii de securitate pot, de asemenea, să îmbunătățească strategiile de guvernanță, reducând riscurile asociate cu soluțiile AI ale terților.

Strategii de punere în aplicare

O guvernanță de succes a IA necesită o abordare structurată a implementării, care să valorifice atât tehnologia, cât și strategiile bazate pe politici. Multe organizații apelează la instrumente de conformitate bazate pe IA pentru a automatiza procesele de guvernanță și a detecta încălcările reglementărilor în timp real. Măsurile cheie de implementare includ:

- Soluțiile de conformitate bazate pe tehnologie utilizează inteligența artificială pentru a urmări respectarea politicilor, a monitoriza factorii de risc și a automatiza procedurile de audit

- Strategiile de gestionare a schimbării asigură adoptarea politicilor de guvernanță a IA în întreaga organizație

- Planificarea răspunsului la incidente abordează riscurile de securitate specifice IA, asigurându-se că organizațiile dispun de măsuri proactive pentru a gestiona eșecurile de guvernanță, atacurile cibernetice și încălcările etice

Prin integrarea cadrelor de guvernanță în politicile existente și adoptarea unor strategii de implementare structurate, organizațiile se pot asigura că sistemele AI rămân sigure, etice și conforme.

Orientări etice și responsabilitate

Pe măsură ce sistemele AI influențează deciziile cu miză mare, organizațiile trebuie să stabilească orientări etice și structuri de răspundere pentru a asigura utilizarea responsabilă. Fără garanții de guvernanță, AI poate introduce prejudecăți, compromite securitatea sau poate funcționa în afara limitelor de reglementare.

Stabilirea orientărilor etice

Guvernanța etică a IA se concentrează pe corectitudine, transparență și securitate. Următoarele practici sunt esențiale pentru construirea unei baze etice în dezvoltarea și implementarea IA:

- Principiile și standardele pentru inteligența artificială etică contribuie la asigurarea funcționării inteligenței artificiale în limite acceptabile, evitând consecințele neintenționate

- Elaborarea unui cod de etică formalizează utilizarea responsabilă a IA, stabilind orientări clare privind transparența, confidențialitatea datelor și responsabilitatea

Crearea structurilor de responsabilizare

Pentru a se asigura că guvernanța IA este aplicabilă, organizațiile au nevoie de mecanisme care să urmărească conformitatea și să permită acțiuni corective. Măsurile comune de responsabilizare includ:

- Auditurile AI evaluează performanța modelului, conformitatea și vulnerabilitățile de securitate

- Planificarea răspunsului la incidente pregătește organizațiile pentru a face față eșecurilor legate de inteligența artificială, breșelor de securitate și lacunelor de guvernanță

Prin integrarea orientărilor etice și a măsurilor de responsabilizare în cadrele de guvernanță, organizațiile pot gestiona riscurile IA, menținând în același timp încrederea și conformitatea.

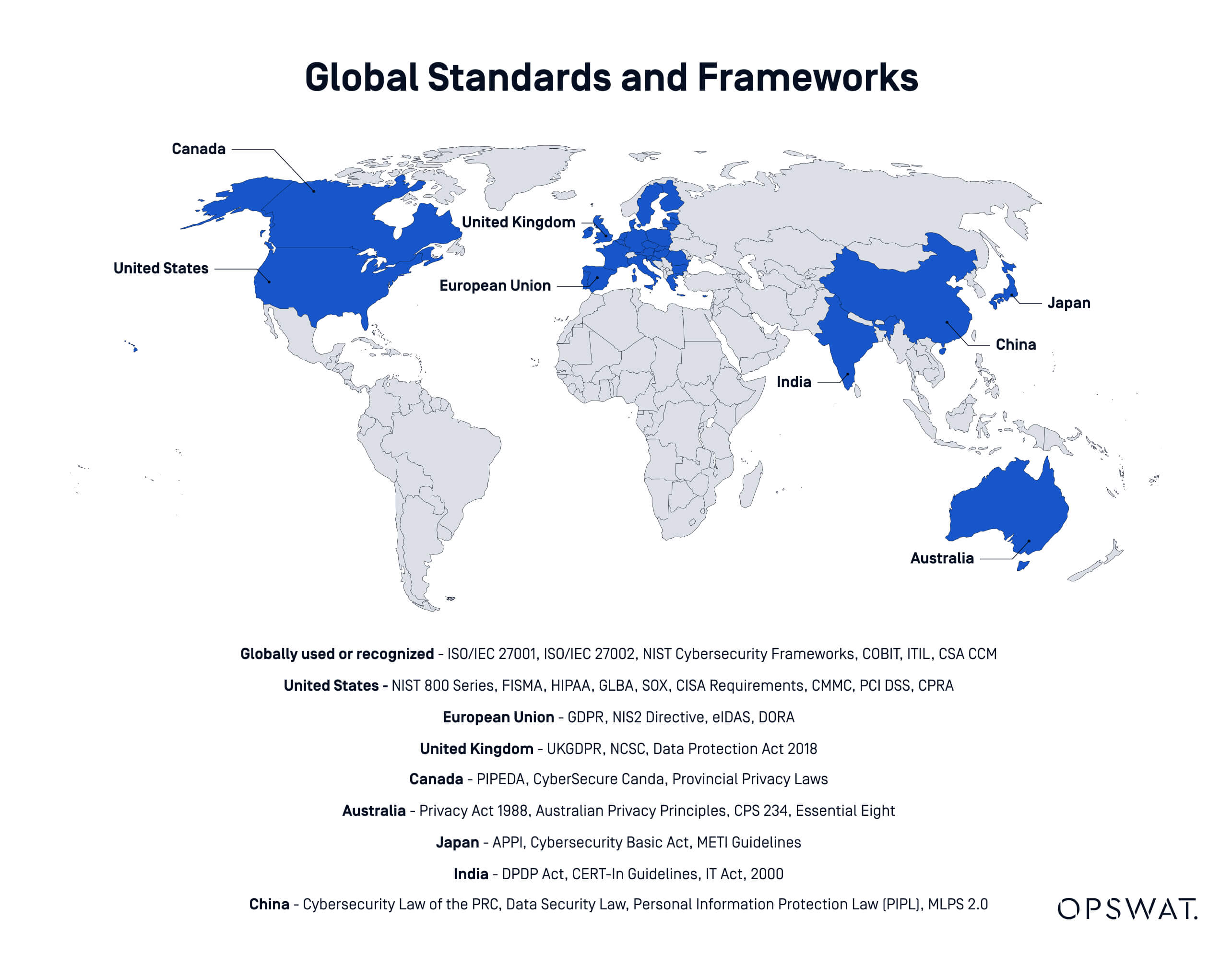

Cadre de reglementare

Conformitatea cu cadrele de reglementare este esențială, însă multe organizații se luptă să țină pasul cu evoluția politicilor. Potrivit Deloitte, incertitudinea în materie de reglementare este principalul obstacol în calea adoptării IA, multe întreprinderi implementând structuri de guvernanță pentru a aborda riscurile de conformitate.

Prezentare generală a reglementărilor globale

Guvernanța IA este modelată de legi specifice fiecărei regiuni, fiecare având cerințe de conformitate distincte. Exemplele de mai jos ilustrează modul în care reglementările variază între jurisdicțiile cheie:

- Actul UE privind inteligența artificială stabilește o supraveghere strictă, impunând transparență, evaluări ale riscurilor și supraveghere umană pentru aplicațiile de inteligență artificială cu risc ridicat. În conformitate cu articolul 6, sistemele de IA sunt considerate cu risc ridicat dacă operează în sectoare de infrastructură critică. Organizațiile care își desfășoară activitatea în UE trebuie să își alinieze politicile privind IA la aceste orientări.

- SR-11-7 din Statele Unite stabilește așteptările în materie de gestionare a riscurilor pentru IA în instituțiile financiare, concentrându-se pe validarea modelelor, guvernanță și controale de securitate. Orientări sectoriale similare sunt în curs de apariție în toate industriile.

- Alte politici internaționale, inclusiv reglementările din Canada, Singapore și China, pun accentul pe utilizarea etică a IA, protecția consumatorilor și responsabilitatea întreprinderilor. Întreprinderile trebuie să urmărească evoluția reglementărilor în regiunile în care implementează IA.

Prin integrarea orientărilor etice și a măsurilor de responsabilizare în cadrele de guvernanță, organizațiile pot gestiona riscurile IA, menținând în același timp încrederea și conformitatea.

Strategii de conformitate

Asigurarea conformității cu reglementările privind IA necesită o abordare proactivă. Următoarele strategii ajută organizațiile să alinieze cadrele de guvernanță la cerințele legale în continuă evoluție, în special atunci când lucrează cu sisteme AI cu risc ridicat:

- Construirea unei echipe de conformitate permite organizațiilor să gestioneze riscurile de reglementare, să supravegheze auditurile IA și să pună în aplicare măsurile de guvernanță necesare

- Parcurgerea provocărilor în materie de reglementare presupune monitorizarea continuă a schimbărilor de politică și, în același timp, adaptarea structurilor de guvernanță într-un mediu complex de reglementări care deseori se suprapun

- Auditurile de reglementare și raportarea ajută organizațiile să demonstreze conformitatea și să prevină riscurile juridice prin monitorizare proactivă

Prin integrarea strategiilor de conformitate în cadrele de guvernanță ale IA, organizațiile pot reduce riscurile de reglementare, asigurându-se în același timp că IA rămâne etică și sigură.

Transparență și explicabilitate

Organizațiile se confruntă cu o presiune din ce în ce mai mare pentru a face explicabile deciziile bazate pe inteligența artificială, în special în aplicații cu risc ridicat, cum ar fi finanțele, asistența medicală și securitatea cibernetică. În ciuda acestui fapt, multe modele de inteligență artificială rămân complexe, limitând vizibilitatea modului în care acestea funcționează.

Proiectarea unor sisteme AI transparente

Transparența IA presupune ca procesele decizionale să fie ușor de înțeles pentru părțile interesate, autoritățile de reglementare și utilizatorii finali. Următoarele abordări sprijină explicabilitatea inteligenței artificiale și contribuie la reducerea riscurilor asociate așa-numitelor modele de inteligență artificială de tip "cutie neagră", ale căror funcționări interne nu sunt ușor de înțeles:

- Strategiile de comunicare eficiente ajută organizațiile să transpună deciziile privind inteligența artificială în rezultate clare și interpretabile. Furnizarea de documente, rezumate ale modelelor și evaluări ale impactului poate îmbunătăți transparența.

- Instrumentele și tehnologiile pentru transparență asigură inteligența artificială explicabilă, oferind informații despre modul în care modelele de inteligență artificială prelucrează datele și generează rezultate. Instrumentele de audit al IA, cadrele de interpretabilitate și tehnicile de IA explicabilă (XAI) contribuie la atenuarea preocupărilor legate de luarea deciziilor în cutie neagră.

Prin prioritizarea transparenței, organizațiile pot îmbunătăți alinierea reglementărilor, pot reduce riscurile legate de prejudecăți și pot consolida încrederea în aplicațiile AI.

Monitorizarea și îmbunătățirea continuă

Guvernanța IA este un proces continuu care necesită monitorizare, evaluare a riscurilor și perfecționare continuă pentru a asigura securitatea și conformitatea. Pe măsură ce sistemele bazate pe IA gestionează volume tot mai mari de date sensibile, organizațiile trebuie să stabilească fluxuri de lucru sigure pentru a preveni accesul neautorizat și încălcările reglementărilor.

Soluțiile de gestionare a transferului de fișiere joacă un rol esențial în aplicarea politicilor privind inteligența artificială, menținerea auditabilității și reducerea riscurilor de conformitate în schimburile de date bazate pe inteligența artificială.

Măsurători de performanță și bucle de feedback

Urmărirea performanței sistemului IA este esențială pentru asigurarea fiabilității, securității și conformității. Următoarele practici contribuie la o monitorizare robustă și la o guvernanță adaptivă:

- FluxurileSecure împiedică accesul neautorizat și garantează că schimburile de date bazate pe inteligență artificială respectă politici stricte de securitate. MetaDefender Managed File Transfer MFT)™ OPSWATpermite organizațiilor să aplice criptarea, controalele de acces și monitorizarea automată a conformității pentru a reduce riscul de expunere a datelor.

- MecanismeleAdaptive de guvernanță permit modelelor de inteligență artificială să rafineze procesul decizional pe baza feedback-ului continuu, menținând în același timp măsuri stricte de securitate și conformitate. Soluțiile de securitate bazate pe AI, cum ar fi platformele Managed File Transfer , ajută la clasificarea datelor sensibile în timp real, asigurând respectarea cerințelor de reglementare în continuă evoluție.

Crearea de cadre de risc pentru îmbunătățirea continuă

Fluxurile de lucru bazate pe inteligență artificială trebuie să fie evaluate în permanență în ceea ce privește vulnerabilitățile, în special pe măsură ce amenințările cibernetice evoluează. Potrivit Forumului Economic Mondial, 72% dintre organizațiile întrebate au raportat o creștere a riscurilor cibernetice în ultimul an, determinată de creșterea numărului de cazuri de phishing, inginerie socială, furt de identitate și fraudă cibernetică. Următoarele strategii susțin reziliența pe termen lung:

- Aplicarea securității bazată pe IA protejează schimburile de date IA prin integrarea detectării avansate a amenințărilor, prevenirea pierderii datelorși controale de conformitate. MetaDefender Managed File Transfer MFT)™ asigură organizațiilor transferul în siguranță al datelor sensibile IA fără a crește expunerea la reglementări.

- Aplicarea automatizată a conformității simplifică respectarea reglementărilor prin aplicarea politicilor de securitate predefinite pentru toate transferurile de fișiere legate de IA. Prin utilizarea soluțiilor de guvernanță bazate pe IA, organizațiile pot reduce riscul de încălcare a securității datelor, menținând în același timp eficiența operațională.

Prin integrarea fluxurilor de date securizate în strategiile de guvernanță AI, organizațiile pot îmbunătăți securitatea, menține conformitatea și asigura integritatea procesului decizional bazat pe AI. Soluții precum MetaDefender Managed File Transfer MFT) oferă garanțiile necesare pentru a sprijini operațiunile AI sigure și conforme.

MetaDefender Managed File Transfer MFT) – Soluție de securitate și conformitate bazată pe inteligență artificială

MetaDefender Managed File Transfer MFT) joacă un rol crucial în guvernanța securității AI, oferind:

- Transferuri de fișiere bazate pe politici care aplică automat controale de securitate, precum restricții de acces, cerințe de criptare și validarea conformității

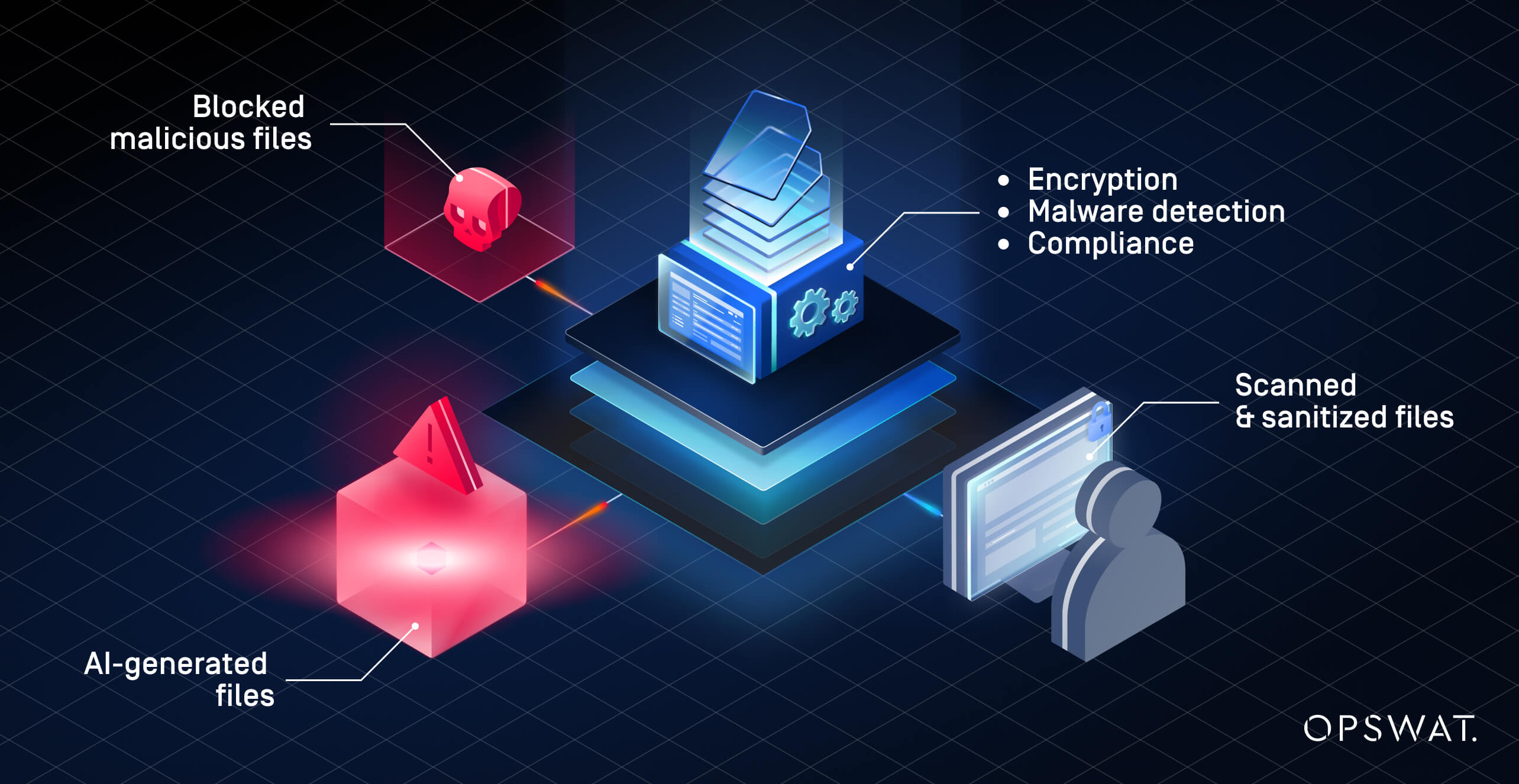

- Prevenirea avansată a amenințărilor prin detectarea în straturi care identifică și blochează malware, ransomware, scripturi încorporate și alte amenințări bazate pe fișiere utilizate în mod obișnuit în atacurile generate de inteligența artificială

- Măsuri de securitate bazate pe conformitate care susțin mandatele de reglementare, inclusiv GDPR, PCI DSS și NIS2, prin integrarea înregistrărilor de audit, a controalelor de acces bazate pe roluri și a aplicării politicilor personalizabile

- Fluxuri de lucru de dateSecure și gestionate care asigură că transferurile de fișiere bazate pe inteligența artificială sunt criptate (AES-256, TLS 1.3), verificate din punct de vedere al integrității și protejate împotriva manipulării sau injecției de sarcini utile rău intenționate pe parcursul procesului de schimb

- Prin integrarea Multiscanning motoare euristice și de învățare automată, tehnologia Deep CDR™ și tehnologiile de sandboxing bazate pe IA, MetaDefender Managed File Transfer MFT) protejează datele generate de IA împotriva amenințărilor cibernetice în continuă evoluție, asigurând în același timp respectarea reglementărilor privind guvernanța IA.

Securizarea fluxurilor de date bazate pe inteligența artificială

Modelele AI se bazează pe volume mari de date care se deplasează adesea între mai multe sisteme, ceea ce face ca transferurile de date securizate să fie esențiale. Fără controale adecvate, datele generate și prelucrate de AI pot fi vulnerabile la falsificare, acces neautorizat sau încălcări ale conformității.

MetaDefender Managed File Transfer MFT) asigură protecția fluxurilor de date bazate pe inteligență artificială prin:

- Criptare end-to-end utilizând AES-256 și TLS 1.3, securizând datele atât în tranzit, cât și în repaus

- Autentificare strictă și controale de acces cu integrarea Active Directory, SSO (single sign-on) și MFA (multi-factor authentication) pentru a preveni schimburile neautorizate de date

- Verificarea integrității datelor prin validarea sumei de control, asigurând că fișierele generate de AI nu sunt modificate în timpul transferurilor

Prin aplicarea acestor măsuri de securitate, organizațiile pot integra în siguranță procesele bazate pe inteligența artificială în infrastructura lor existentă, fără a expune datele sensibile la riscuri.

Prevenirea amenințărilor cu ajutorul inteligenței artificiale

Conținutul generat de IA introduce noi provocări în materie de securitate, inclusiv atacuri IA ostile, malware încorporat și exploatări bazate pe fișiere. MetaDefender Managed File Transfer MFT) consolidează securitatea prin mai multe straturi de protecție, prevenind atacurile cibernetice bazate pe IA înainte ca acestea să ajungă la sistemele critice.

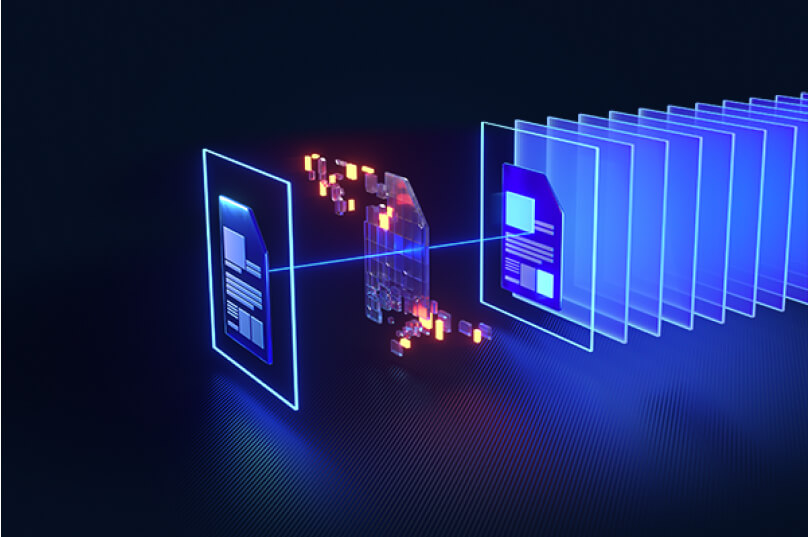

Tehnologia Metascan™ Multiscanning utilizează peste 30 de motoare anti-malware pentru a detecta amenințările cunoscute și cele de tip zero-day, asigurându-se că fișierele generate de AI sunt lipsite de sarcini utile rău intenționate. Aflați mai multe despre această tehnologie aici.

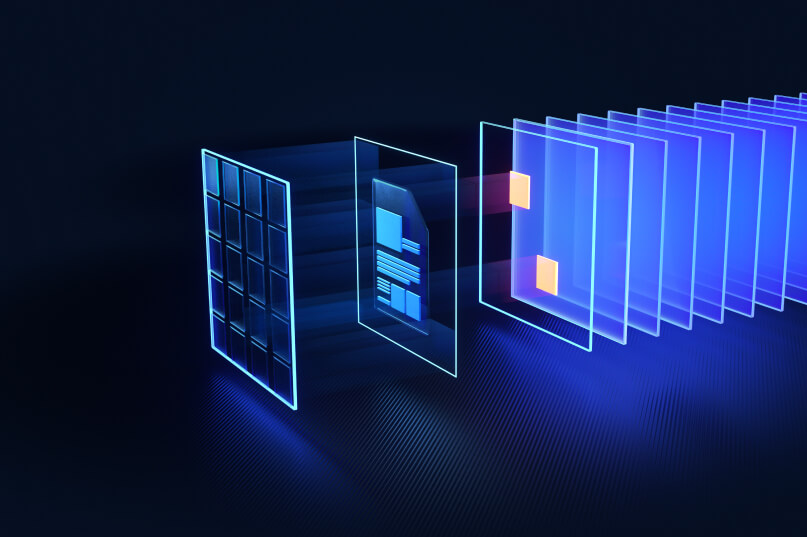

Tehnologia Deep CDR™ elimină amenințările ascunse, îndepărtând conținutul activ din fișiere fără a afecta funcționalitatea acestora — un pas esențial în prevenirea exploatărilor generate de inteligența artificială. Află mai multe despre cum funcționează aici.

MetaDefender detectează programele malware care încearcă să se ascundă prin executarea fișierelor suspecte schimbate prin intermediul inteligenței artificiale într-un mediu izolat, analizând comportamentul acestora pentru a descoperi amenințări care nu pot fi detectate de măsurile tradiționale de securitate. Citiți aici ce spun clienții despre această tehnologie.

Aceste capacități fac din MetaDefender Managed File Transfer MFT) o soluție de securitate completă pentru organizațiile care se bazează pe schimburi de date bazate pe inteligență artificială și care trebuie să prevină infiltrarea malware-ului și încălcarea conformității.

Guvernanța AI bazată pe conformitate

Datele generate de IA sunt supuse unei supravegheri stricte din partea autorităților de reglementare, care impun organizațiilor să implementeze politici de securitate care să asigure conformitatea cu cadrele juridice în continuă evoluție. MetaDefender Managed File Transfer MFT) ajută companiile să îndeplinească aceste cerințe prin integrarea unor controale proactive de conformitate în fiecare transfer de fișiere:

- Proactive DLP™ scanează fișierele generate de AI pentru conținut sensibil, prevenind expunerea neautorizată a datelor și asigurând conformitatea cu reglementări precum GDPR, PCI DSS și NIS2

- Jurnalele de audit cuprinzătoare și rapoartele de conformitate oferă vizibilitate asupra transferurilor de fișiere legate de AI, permițând organizațiilor să urmărească accesul, modificările și aplicarea politicilor

- RBAC (controale ale accesului bazate pe roluri) aplică permisiuni granulare, asigurându-se că numai utilizatorii autorizați pot accesa sau transfera fișiere legate de IA în conformitate cu politicile de guvernanță

Cu aceste capacități de guvernanță, MetaDefender Managed File Transfer MFT) nu numai că securizează datele AI, dar ajută și organizațiile să se alinieze cerințelor de reglementare, reducând riscurile legale și operaționale asociate proceselor bazate pe AI.

Consolidați securitatea AI cu MetaDefender Managed File Transfer MFT)

Fluxurile de date bazate pe IA necesită controale solide de securitate și conformitate. MetaDefender Managed File Transfer MFT) oferă soluții avansate de prevenire a amenințărilor, conformitate cu reglementările și schimb securizat de date pentru medii bazate pe IA. Aflați mai multe despre modul în care soluția de transfer de fișiere gestionată OPSWAT,MFT , lider în industrie,MFT îmbunătăți strategia dvs. de guvernanță IA.